随着大模型元宇宙热潮日渐高涨,虚拟主播、虚拟客服等数字人已从科幻走进现实。他们的语言、动作、表情等都十分接近真人。这样的虚拟数字人是如何打造出来的?5月19日举行的全国首个高校大模型元宇宙科创大赛——第四届“天马杯”全国高校科技创新大赛(简称“天马杯”)决赛将为大家揭秘。

据大赛主办方马上消费金融股份有限公司(下称“马上消费”) 副总经理兼首席信息官蒋宁介绍,本次大赛将赛道集中在前沿科技领域,以元宇宙为核心,设置了2D数字人驱动、3D数字人驱动、NLP(自然语言处理,属于人工智能的一个子领域) 三个赛道。

其中,2D数字人驱动赛道的赛题为“语音驱动数字人口型生成”,3D数字人驱动赛题为“视频驱动人脸生成”,NLP赛道赛题为“数字人播报资讯内容生成”。在前期的预赛中,参赛团队围绕这三大赛题进行开发,取得了让数字人具备“人的行为模式”的创新成果。决赛中,他们将通过现场演示、答辩,展示这些创新成果。

譬如,在2D数字人驱动赛道中,主办方提供了一系列真人录制的音画同步的短视频,以及对应的其中人脸的3DMM参数(这个参数用来表示人脸关键点位的空间坐标和形变)。有赛队基于这些数据开展建模训练,实现了通过分析语音信号中的语调、语速、情感等信息来预测说话人的面部表情。据此,可以一张图片和通过语音生成的表情参数作为输入,生成与输入语音同步的说话人人脸视频。

在3D数字人驱动赛道中,主办方提供了一系列真人录制的人脸短视频,以及对应的其中人脸的BlendShape参数(用于描述人体表面形状变化的参数)。有赛队基于这些数据,根据输入人脸提取的关键点信息与基准的人脸关键点计算差值,然后用差值加上额外计算参数输入模型去预测人脸表情变化。据此,仅通过摄像头就能捕捉面部表情并构建3D人脸模型。

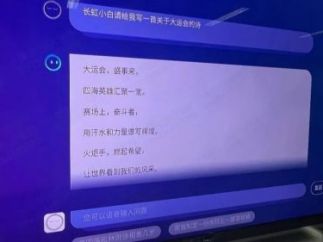

在NLP赛道中,主办方提供了一系列基于真实新闻得到的素材——新闻以及与之相关的训练数据和测试数据。有赛队基于其中的训练数据,探索多种可行的预训练模型并最终选定一种模型,打造出了数字人新闻播音员。该数字人新闻播音员能够基于关键新闻素材(如时间、地点、人物、事件等)生成一段通畅、易读的资讯新闻。

蒋宁表示,随着大模型概念火爆,各种虚拟数字人如潮水般涌现。而另一方面,元宇宙又对虚拟数字人的语言、动作、表情等提出了更高的要求,需要虚拟数字人像真人一样“动起来”。在此背景下,“天马杯”决赛设置上述三大赛道,旨在以比赛促进数字人技术创新发展,探索让数字人能真实还原真人表情、语言和动作的新方法、新路径。

“参加本次比赛之前,我们团队也在研究数字人,但往往更偏重理论,实用性不大。而本次比赛和我们平时的研究有一定的相关性,有利于我们将所学理论知识与实践相结合,提高团队开发数字人的技术水平。”参赛队代表USTC-Qingbo赛队队长李弘毅说。