自我们购买的Vision Pro从美国漂洋过海并于2月下旬抵达我们手中,已经过去了3周时间。

有句俗话说得好:「纸上得来终觉浅,绝知此事要躬行」。尽管在Vision Pro到手前,我们已经通过诸多媒体发布的评测,做了足够多的心理建设,但真正亲身体验Vision Pro后,我们才发现,这是一款有些「挑用户」的产品——它的长处和不足都太过突出,这也就注定了喜欢Vision Pro的人会对其赞不绝口长时间沉浸其中,不喜欢的人甚至可能连短短几分钟的体验都无法坚持到底。

在这三周的时间里,我们一边不断在体验Vision Pro的各项功能和内容,一边也在思考着这款设备的价值所在。

可以确定的是, Vision Pro已经展现了空间计算蕴涵的深厚潜力,从工作学习到娱乐生活,空间计算将会引领新一轮数字体验的重构,但距离空间计算时代真正的来临究竟还有多远,我们暂时还没有能够从Vision Pro身上找出确切的答案。

而至于值不值得花费近3万元人民币的高昂成本,做一次空间计算时代的「超前消费」,相信你在看完我们的观点后,也将得出自己的答案。

Vision Pro带来了顶级视觉体验,但待优化的地方依然很多

在此前的文章中,我们曾基于外媒的评测和评价,总结了Vision Pro的优缺点。但在真正拿到Vision Pro并进行了长时间的使用后,我们还是有一些不一样的感受。

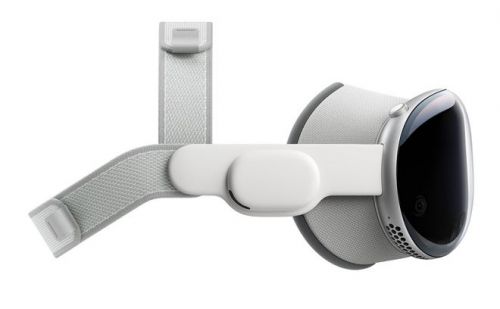

对于这样一台售价近3万元人民币的设备,苹果对Vision Pro的质感下足了功夫,从头带的金属卡扣、扬声器的设计、电源接口、脑后的织物包裹等方方面面的细节,再一次诠释了苹果极高水准的设计能力,让Vision Pro仅仅从外观上就和塑料感更重的Meta Quest 3乃至PICO 4这样的产品拉开了差距,无形之中拉高了人们对于这款设备价格的阈值,让人们能够在第一印象就认可这是一款昂贵的高端硬件。

佩戴上Vision Pro,我们的第一感受是清晰。

一方面,苹果Vision Pro的VST(Video See Through视频透视)功能是目前所有具备VST功能的头显中最清晰、延迟最低、畸变最小的,因此通过Vision Pro的VST功能我们看到的周围环境与不佩戴Vision Pro时看到的周围环境在物体大小、视场角方面保持了很好的一致性;

另一方面,得益于两块来自索尼的高端4K分辨率Micro-OLED屏幕,所有由Vision Pro渲染的画面内容——包括UI、背景等等,以前所未有的清晰度呈现在了眼前,在其他所有消费级VR头显上都能看到的像素点消失无踪,这也是消费级VR头显首次在清晰度上能够与电脑显示屏、手机、平板电脑等人们日常使用的设备站在同一起跑线上,不会让消费者在体验环节的第一步就要做出妥协。

然而在度过了初见的震惊期以后,我们的感受有了些许落差——Vision Pro的显示效果在某些方面还是没有达到我们的心理预期,尤其是在事先已经从首批评测者那里听到了相当多好评的情况下。

首当其冲的,仍然是VST。相比肉眼直接观察到的世界,Vision Pro的VST画面具有明显的模糊感,这种模糊并不是来自于摄像头导致的运动模糊,而是你能非常直观的感受到画面中物体的轮廓不够清晰。最显著的例子便是使用Vision Pro的VST功能来阅读手机或者是书籍上较小的文字,相比平常不戴头显时所用的较为舒适的阅读距离,在Vision Pro的VST功能下你需要将物体拿的更近一些才能对文字有比较好的辨识度。

这种清晰度的差异在Vision Pro的界面从VST背景中浮现出时会极为明显,官方资料显示,Vision Pro采用了650万立体像素的前置摄像头,将这一数量的像素还原到双眼2300万像素的屏幕上,模糊也是一个必然的结果。

不过当你开始使用Vision Pro中的应用时,就会暂时忽略掉VST的模糊,将注意力集中到由Vision Pro渲染的高清界面中。

另外一项明显的落差则来自于Vision Pro的FOV。无论是配合苹果官方定制的蔡司镜片,还是在佩戴隐形眼镜的情况下使用Vision Pro,有一种通过“隧道”看世界的感觉,尤其是垂直方向FOV的窄小,在你尝试向上看以拉出Vision Pro控制中心UI的过程中极为明显。这里我们直接引用AppleInsider的评测数据吧——Vision Pro的水平FOV大约在100°,垂直FOV并未列;作为对比Meta Quest 3的水平FOV大约在110°,垂直FOV大约为96°。

有人指出,如果去掉Vision Pro的遮光罩部分,将眼睛更加贴近透镜可以获得更大的FOV,而且Vision Pro的Pancake镜片为内凹设计不用担心眼睛与镜片的距离,拿掉遮光罩后我们进行了尝试,眼睛越贴近的确横向FOV能得到一定的增强,但是在垂直方向上会出现黑边。

有趣的是,去掉遮光罩后,Vision Pro的体验提升反而在另一个方面涌现——我不再感觉到自己被困在了一个狭窄的视野中,眼睛的余光能够看到现实世界,同时与Vision Pro的VST画面也能很好的接合,让整个使用体验变得像是佩戴了一副粗边框的眼镜,与现实世界的疏离感也随之下降。不知道苹果官方或者是华强北什么时候能够推出这样一款更具开放感的面罩,对于Vision Pro的体验是大大的加分项。

还需要说的则是镜片鬼影的问题,在较暗的背景上呈现亮度较高的元素时,Vision Pro非常容易产生鬼影,最直观的感受是本应该黑暗的部分像蒙上了一层雾一样被照亮,

在使用了一段时间后,尤其是当视觉上的冲击消散后,Vision Pro的重量感开始压过其他感受引起你的注意,大约650克的重量坠在颧骨上,比较容易导致肌肉受压产生酸痛感。这也是苹果后续为Vision Pro配备了另一根头带——在头顶部增加了支撑的Dual Loop Band的原因。

不过Dual Loop Band毕竟是后增加的配件,受到Vision Pro自身设计的限制,只加入了一根横向的支撑带,而VR头显则大多采用纵向的支撑带,能够更好的分散因头显自身重量带来的面部压力。

或许这也是苹果在发布会的视频中主要展示了坐在沙发上使用Vision Pro的原因:斜靠在沙发背上,头微微上扬,的确是我们在使用Vision Pro后发现的最舒服的使用姿势。我们现在非常期待苹果官方或者第三方配件厂商能够推出新的配件改变这种压脸的佩戴体验。

而电源何时能从外置变为内置,也要取决于Vision Pro后继产品的减重瘦身能够取得多大的成效。

接下来聊一聊交互方面。

Vision Pro的交互采用了眼球追踪与手部追踪接合的方案,对于所有的交互元素都提供了直接用手触碰和眼睛注视+手指捏和的方式,舍弃了通常VR头显配合使用的控制器。

从实际体验来说,这种眼+手接合的交互方式,能够很好的与位于不同距离的元素进行互动,是一种降低用户交互负担的优秀方式,也能够很好的兼容人们熟悉的触屏设备交互方式——眼睛确认想要交互的元素,手部动作进行想要的操作。

然而,在这样的交互流程中,Vision Pro也暴露出了一些明显的问题。

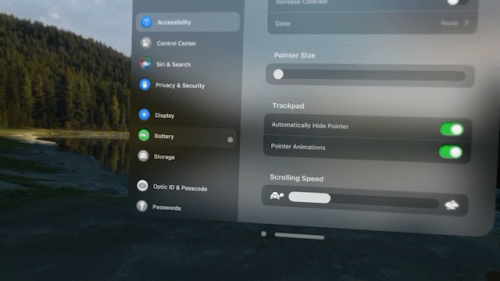

其一是眼睛注视焦点的切换有一定的滞后和抖动,这个问题在可交互元素距离非常近的情况下比较明显,尤其是窗口下方关闭应用的圆圈和右侧用于调整窗口位置的长条,经常出现想要关闭窗口焦点却始终位于长条形上的情况,需要转动眼球做一些注视位置的调整才能得到正确的识别,偶尔还会产生焦点在元素之间反复跳跃的情况,加重了用户的用眼负担,容易产生疲劳感。

当然,这一现象不仅仅和摄像头的延迟有关,可能和眼球追踪的精确性和稳定性也有关系。当我们在Accessability菜单中开启显示眼球焦点的指针后,也终于明白了为什么会出现这样的情况——画面中显示的指针有肉眼可见的快速抖动,进而可能会在某些情况下影响到邻近元素的交互。

其二是手部追踪的问题。手部追踪延迟的问题在沉浸式应用中会较为明显,无论是VST抠图后双手的画面、又或是应用附着在双手上显示的虚拟元素,只要你的双手移动速度稍微快一些,盯着双手画面的裁剪处,就能够明显的感受到它们的响应速度相较于你双手的动作要慢上半拍。

手部追踪的另一个问题在于,Vision Pro仅追踪了用户双手的食指,因此在使用虚拟键盘输入文本时,我们不得不退化到电脑初学者一指禅式的打字方式,而且由于食指会穿过虚拟键盘,因此当你连续输入文本时如果手指从虚拟键盘上抬起的距离不够,就会带来按键误触的问题。

这两个问题带来的结果,是Vision Pro的输入效率要低于我们更常使用的键盘和鼠标。当然,Vision Pro可以通过蓝牙连接苹果的妙控键盘和触摸板,但这不仅是一笔昂贵的额外开支,在Vision Pro的垂直FOV特别受限的情况下,输入法的选词和预览绑定在虚拟键盘界面而不是光标处,意味着用户还是需要更多的进行低头与抬头,来确保输入的内容准确无误。

关于交互,我们最后想说的是Optic ID。这一功能的引入让用户登入、App Store购买应用等等一些需要用户进行身份验证的环节变得极为简便,尤其是在Vision Pro输入文本效率较低的情况下。苹果Optic ID的识别也是相当稳定,在代表Optic ID启动的图标出现时候只要用户注视图标不要看向其他方向,识别几乎不会失败,速度也和iPhone使用的Face ID相当,值得作为所有头显类设备的标配功能进行推广。

至于我们最想吐槽的功能,那一定是EyeSight。

夸张一点说,Vision Pro发布会宣传片的EyeSight效果几乎可以称得上是照骗。因为采用了裸眼3D技术,EyeSight显示的画面不仅清晰度较低,而且也因为光线被折射向了不同的方向导致了亮度的显著降低。最后的结果就是受到亮度限制在许多环境下你很难透过Vision Pro的玻璃面板看清楚显示的双眼,即使在某些时候亮度达标了,其模糊的画面也很难和你的面部融合到一起。

尽管苹果一再强调了Vision Pro可以让用户和周围的人进行眼神的交流,但在这样的情况下眼神交流能否传递有效的信息是没有办法得到保证的。

从系统到生态,Vision Pro距离空间计算生产力工具还有多少路要走?

聊完了硬件体验和交互,接下来我们聊一聊大家最关心的Vision Pro内容生态吧。

自北京时间2月3日Vision Pro正式发售,到本文发出时间已经一个月有余,尽管苹果宣称已经有1000多款专为Vision Pro开发的应用上架了App Store,但实际体验下来后,除了用来观看视频、电影和偶尔体验几款休闲游戏作为消遣,真正能吸引用户长时间使用的应用的确乏善可陈,尤其是在生产力工具方面,如果不使用Macbook的投屏功能,你很难进行除文字处理类型之外的工作。

先说说好的方面吧。

用Vision Pro来观看视频和电影体验拉满,两块4K分辨率的Micro OLED屏幕不仅将画面的清晰度拉到最高,也继承了OLED屏幕一贯以来色彩鲜艳的特点,相比走进影院观看3D电影还要佩戴偏光眼镜带来画面亮度的减弱和色彩的淡去,Vision Pro毫无疑问已经成为了3D电影的最佳打开方式。

在苹果自带的Apple TV+应用和曾在Vision Pro发布会上露脸的Disney+应用中,我们还可以自行设置观影的环境。例如,你可以在Disney+应用的主菜单中将环境调整为复联大厦的顶楼,一览城市的繁华景观,当电影开始后背景后自动切换到夜景,减弱背景光线对于观影的影响。

Vision Pro的空间音频能力对于观影体验来说也是优秀的加分项。即使只使用Vision Pro自带的扬声器,我们也能够清楚的辨认出声音来源的方向,不仅加强了观影时的沉浸感,还能够响应空间中不同应用的所在位置,更好的融合了现实与虚拟的环境。

Vision Pro也拥有不错的多任务能力。在共享空间(Shared Space)中,你可以同时打开多个应用窗口并同时进行运行,这意味着你可以一边刷着B站,一边打开喜欢的游戏玩上两盘,还能打开新闻和股票软件对发生的时事保持关注,用一台设备实现过去需要多块屏幕才能实现的功能,也是Vision Pro的一大卖点。

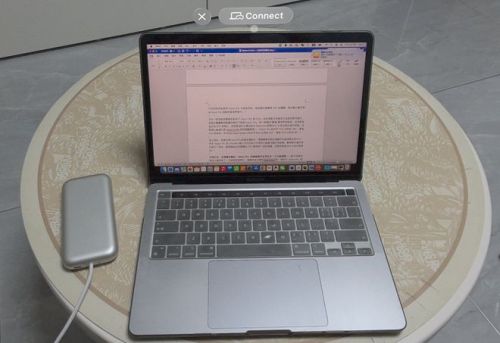

这里提一嘴过去VR头显在使用过程中的两个痛点——一是如何将其他设备的画面投影到VR中,二是如何将VR中的画面投影到其他设备中。而Vision Pro凭借着苹果一贯重视的多设备联动能力,在苹果的生态范畴内给出了非常顺畅的投屏解决方案。

在控制中心里,我们可以很方便的将Vision Pro中的画面投影到登录同一App ID的iPhone、iPad以及Mac上,也能够投影到支持Air Play功能的智能电视机上,尽管输出的视频流仅有720P远远赶不上Vision Pro中画面的清晰度,但输出的画面却不是以往VR头显设备那样仅仅输出了单眼的画面,而是将双眼画面做了合成,100%的重现了Vision Pro用户的视角。这无论对于分享Vision Pro体验还是对于指导新手熟悉Vision Pro的使用,都十分的便利。

Vision Pro连接Mac也十分方便,只要使用同一App ID登录并且处于同一网络中,Vision Pro控制中心Mac投屏功能的列表中就会出现对应的电脑。在首次通过控制中心完成连接后,后续Vision Pro的视野中只要出现了这台Mac,屏幕上方就会弹出菜单,一点即实现Mac向Vision Pro投屏。

接着说说Vision Pro的局限性。

Vision Pro的操作系统visionOS基于iPad OS开发而非mac OS开发,这本身就为Vision Pro成为生产力工具设置了一定的障碍。

首先还是Vision Pro的多任务能力。操作系统对多任务的支持,以及在不同任务之间调配系统资源的能力,对于生产力工具而言是非常重要的。但visionOS在前台和后台的系统资源调度方面延续了iPad OS的设置,存在着先天性的不合理——当处理器负载见顶时,visionOS依然选择了将处理能力较为平均的分配给了各项功能,而不是优先保证当前应用和系统功能的流畅。这样的调度方式对于iPad这样因显示屏幕大小而不会同时启动太多应用的设备不会产生任何问题,但对于同时运行应用数量不受限制的Vision Pro来说,问题就大了去了。

在我们的实际测试中,Vision Pro同时开启5-6个应用(3个三维应用,1个视频应用,1-2个平面窗口应用)后,处理器的负载就已经接近顶峰,画面开始出现较为明显的掉帧现象;眼球追踪和手部追踪的响应延迟也显著升高;通过数字表冠呼出应用列表界面响应变慢;启动应用耗时变多,即使是进入设置等系统菜单也非常迟钝;在严重的时候,甚至会出现渲染画面的撕裂。

这种现象并非孤例。我们在开启了屏幕镜像的情况下开启JigSpace应用查看一些较复杂的三维模型时,也能够感受到帧率明显的降低和手势交互延迟的增加。

换句话说,前台和后台,visionOS是一个都没有保住。

此外,Vision Pro中我们如果只是通过界面下方按钮关闭应用,其实并没有真正关闭它,而是让其转入后台,并依照后台应用刷新的设置决定是继续运行还是转入休眠状态,只有当用户长按数字表冠和拍摄键调出任务管理器后,才能真正结束应用的运行释放出全部的占用资源给到正在运行的应用。

在我们接触过的开发者中,也有人向我们提起过Vision Pro在性能上的一些限制:根据粗略估算,开发Vision Pro应用时能够调用的计算资源和中高端iPhone相近,可能要低于iPhone Pro Max版本能调用的计算资源。

当然,这个数据仅供参考,并未经过详细的考证,但也能从侧面反映出,即使Vision Pro使用的是面向笔记本平台的M2芯片,由于空间定位、眼球追踪、手部追踪、高分辨率的画面渲染等等功能和特性已经占用了许多计算资源,真正留给应用程序的计算资源是相对有限,对于一些性能开销大的生产力工具来说,Vision Pro的实际使用效果可能会受到一定的限制。

其次是目前的内容生态还需要打磨。目前已经有超过1000款应用为Vision Pro完成了适配,但是无论在数量上、种类的丰富程度上、还是整体的应用体验上,目前这批适配Vision Pro的应用依然是相对不足的。

一个最直观的例子,便是苹果TV+应用推出的Apple Immersive Video。 在影片一开始,有一段在空中俯瞰河流和山谷的视角,你能够非常明显的察觉到,即使这一影片的参数达到了180° 3D 8K,在中远景上依然十分模糊。尤其是如果你适应了Vision Pro通过数字表冠调出的虚拟环境,再和这些视频做出对比,从清晰到模糊的落差非常巨大。

另一个例子,则是苹果推荐的许多空间应用中,并没有真正体现出与传统平面应用的差异。

这里以《割绳子》和《Bloon TD 6》为例吧。

Vision Pro版的《割绳子》,在UI和交互上做了一些调整,窗口的边缘加入了3D模型,并且只需要注视你想割开的绳子然后做一个确认手势即可完成动作,而不是像触屏上那样需要用手指划过绳子来完成切割的动作。

而《Bloon TD 6》则要更加简单一些,基本就是将原先游戏的3D渲2D变为了直接在3D空间中呈现,而且由于一些UI元素较小难以用眼睛精确的瞄准,实际游戏中非常容易产生误操作,相比直接在iPad上游戏体验反而有些下降。

我们也体验了Vision Pro版的「节奏光剑」——「Synth Riders」。这款游戏在整体的设计思路上还是遵循了苹果对Vision Pro的预想,即坐在沙发上使用,交互元素均设计在了一个较低的高度上,同时这款游戏也能让你更直观的感受到Vision Pro对双手追踪存在的延迟,就个人体验来说,和使用了VR手柄的「节奏光剑」在手感上还是有着一定的差距。

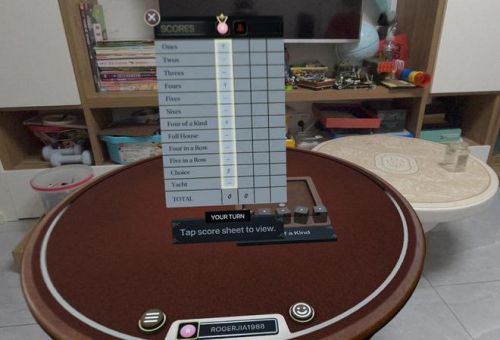

当然,Vision Pro上也不是没有优秀的空间应用,例如「Game Room」,就将一个虚拟的桌游台放到了你周围的现实环境中,让你能够在忙碌的工作之余,给自己来一段休闲放松。将常见的棋牌、卡牌等实体桌游搬到Vision Pro中,利用空间计算的特性对其体验做一些加强,或许是目前最值得探索的空间体验方向之一。

「Game Room」这款空间桌游应用,由Resolution Games研发。而Resolution Games曾开发过多款优秀VR游戏,包括「Demeo」、「Bait!」、「Racket Club」,看来老牌VR内容开发团队对于空间应用的理解要比传统手机游戏的研发商更透彻一些。

另一个值得一提的应用,则是苹果自家的Keynote。相比Mac版本,Vision Pro版Keynote可以模拟会议室或者是剧院的环境来播放你的PPT,既能用来查找和修正PPT中存在的暇疵,编写对应页面的注释,也可以进行一次演讲的预演,对于展示空间计算可以如何在工作中发挥出的重要作用,做了极佳的示范。

但仅仅是几个、十几个甚至是几十个还算不错的应用内容,依然离消费市场对于苹果的预期相去甚远。

用我一个购买了Vision Pro的朋友的话来说,整个内容生态可以用「贫瘠」二字来形容。

我想这里的「贫瘠」,并不是在说Vision Pro应用的绝对数量很少,因为Vision Pro能够兼容iPad应用商店里大部分的应用,而是在说Vision Pro目前的应用中,能够吸引用户长时间去使用的,从虚拟多屏、观影观赛、学习教育、虚拟看房到虚拟购物,大多是已经被VR生态所验证的内容,缺少了一些专属于「Vision Pro」的代表之作,缺少了一些真正让数字内容和现实空间产生互动的体验,也缺少了苹果对于Vision Pro作为生产力工具的真正诠释。

这种结果也可以从App Store应用评论数量上看到一些端倪:一些热门应用,例如Disney+,其评论数量仅有110个,而最火热的短视频应用Tik-Tok也仅仅有175个评价(iPhone和iPad Store这款应用拥有1674万评价),相比于Vision Pro在2月份卖出近20万台的数量来说,用户活跃程度稍显不足。因此,从一款素质优秀的硬件到一款真正有用的生产力工具,Vision Pro还有很多地方需要优化和改进。

可能你会发现,我们略过了作为Vision Pro发布会重头之一的空间视频内容。

并不是这个功能不够出色,而是这项功能的实际体验,其实也和使用者有着很强的关联。如果你是一个注重记录生活、事事讲究仪式感的人,那么用空间视频来记录一些美好的瞬间可能对你具备额外的价值;而如果你是一个简洁直接,相信生活就是自然流淡的人,那么空间视频或许就和普通的视频一样在功能性上并不具备特殊之处。

不巧的是,笔者更靠近后一种性格,因此并不想用自己的感受来影响其他人对这种体验的评价,更倾向于每个人都需要实际体验后才能明白这是不是一项对自己来说有价值的功能。

Vision Pro内容生态走向繁荣,首先应为开发者解除「镣铐」

我们在此前的文章Vision Pro正式发售前夜:不求「完美」,造就非凡中,曾经提到过Vision Pro内容生态需要克服的两大障碍:开发者转化,以及开发工具的问题。这里我们还想再做一些探讨。

什么样的平台能够吸引最多的开发者?

一定是能够让开发者冒最小的风险,挣到最多钱的平台。

对于Vision Pro来说,其风险来自于开发工具的不成熟、开发成本、运维成本的上升、以及目前有限的用户基数;而收益,则是来自于对Vision Pro以及后继产品能够迅速扩大用户基数的预期。

先说说开发和运维成本。

对于3D应用来说,相较于传统移动端应用,Vision Pro双目4K的分辨率不仅带来了视觉体验的上升,也意味着开发者需要为更高分辨率的画面额外制作分辨率更高贴图,以及更多面数的网格模型,以避免因为素材的分辨率过低导致画面呈现效果不佳的情况出现,相较于大多数现存平台之间素材能够通用的情况,无疑拉高了边际成本。

即使是对于视频内容的创作者来收,也需要衡量是否需要创作3D格式的内容和如何选择摄制的分辨率,特别是如果创作的是180度或者360度的全景内容,8K及以上分辨率的3D拍摄设备成本高企的同时,还要面临着原先用于后期制作的设备是否需要升级以应对更高数据处理要求的问题。

而对于像苹果TV+这样的视频平台来说,空间计算也带来了流量成本的上升,以Apple Immersive Video中的Adventure第一季第一集为例,这集内容长度仅有十几分钟,文件体积却接近了8GB,其存储成本和带宽成本相比传统的影视内容都会有较大的攀升。

此外,Vision Pro开发工具的不完善也给开发者们带来了更高的时间成本,可能已经对Vision Pro内容生态的增长产生了影响。

苹果自家的空间内容创作工具Reality Composer Pro从开发者们的反馈来看暂时还不能胜任复杂3D内容的开发;

Unity的开发工具PolySpatial依然有许多BUG等待修复,PolySpatial的渲染管线完全由苹果RealityKit接管限制了使用风格化渲染的可能;

甚至是Vision Pro的模拟器没有很好的模拟出Vision Pro的性能,同时在正式发售前大多数开发者无法拿到实机进行长时间的测试和调整,导致了项目的延期。

还是以Tik-Tok为例,这款应用在Vision Pro的应用商店里收获了大量的差评,而差评的主要因素有两点——一是相比iPhone和iPad端存在功能缺失和Bug,二是这款应用并不是真正的空间应用。至少从第一点来看,Vision Pro版Tik-Tok的确存在着开发周期不足的情况。

而这些因素,都切切实实的在对发售初期Vision Pro的可用内容数量和质量产生影响。

如果在短期内将这些成本都转嫁到消费者头上,其可能导致的一个结果,就是消费者不仅需要以高昂的价格购买一台Vision Pro,还需要为Vision Pro上的许多体验并不如其他平台的应用付出超过其他平台的购买价格;更高的价格又会影响到消费者购买应用的意愿,给应用的销量带来风险。

过去,VR开发者们还可以通过引入风险资本的方式来分摊一部分成本上的风险,在2015-2016年,有相当多优秀的VR开发团队拿到了风投的资金用于项目开发,其中一些佼佼者至今依然活跃在VR内容开发的领域,不断产出优秀的VR内容。

但今时不同往日,XR内容团队已经在很长一段时间内不再被风投机构关注。在Meta Quest系列硬件已经突破2000W销量的当下,有实力的团队已经可以通过这一平台赚到能够养活自己的收入,实力不足的团队本身也难以获得资本的青睐。

尽管我身边也有资本圈的朋友因为Vision Pro的热度想要了解一下XR内容制作领域有什么优秀的标的,然而也仅限于二级市场范畴,对于广大真正撑起了XR内容生态的中小型团队来说并不能起到什么帮助。

可能有人会想,苹果作为一家市值巅峰超过三万亿美元的科技巨头,自己出点成本,在Vision Pro上打造点标杆内容总该可行吧,Meta不也是这么做的么?

问题在于时间。Meta的内容生态循环,是开发出硬件→砸钱给内容团队→团队做出质量优秀的作品→优秀的作品吸引消费者购买更多硬件→消费者的付费超过内容研发成本→团队做出更多质量优秀的作品→正向商业循环建立。Meta不仅耗费了近10年的时间才达成了目前的繁荣,此间的历程中也充满了试错、波折和回撤。

Vision Pro仅仅是一款面市一个月、发布十一个月的设备,苹果对于开发者的号召力比Meta更强,但也还是需要一定的时间来完成内容生态的螺旋式发展。即使是苹果,从内容生产到内容消费的增长循环是无法一蹴而就建立的。

现阶段来说,苹果需要的是增强Vision Pro以及后续硬件对消费者的吸引力,加大对于中小开发者的支持,加强对于开发工具的完善,尽快进入硬件与内容相互促进增长的正循环。有了Meta这个珠玉在前,我们也完全可以给予苹果空间计算内容生态更多的信心。

空间计算仍需坚持「长期主义」,Vision Pro不完美带来更多市场机会

前面我们聊了Vision Pro的优点,也探讨了Vision Pro有待改进的诸多方面。尽管我们更多着墨在了Vision Pro的不足,但并不意味着我们对于空间计算的未来持悲观态度,而是希望能够给想要购买Vision Pro的人更全面更真实的呈现,有了充分了解后再做出购买的选择。

相反,我们坚定的相信苹果在Vision Pro发布时所描绘的空间计算蓝图,是通向下一代计算平台的正确道路。Vision Pro展现的优点与暴露出的不足,不仅将会成为后续苹果改良产品的指南,也为众多XR硬件厂商带来了探索道路上的宝贵经验和发展机会。

就像是Vision Pro内容生态的「贫瘠」,从另一方面来看,意味着市场还存在着大量的空间,即使长短视频的赛道已经相对拥挤,但是消费者对于生产力工具、空间应用和其他娱乐内容的需求依然旺盛,开发者们要做的,是以自身能够承担的成本来适应苹果的开发体系,满足消费者的需求,有计划的探索空间计算的未来。

而跳脱出内容本身,也有更多机遇围绕着Vision Pro和空间计算所涌现。例如更舒适的头带配件和解决近视/远视问题的平价镜片,能更好的兼顾FOV和分辨率的光学显示方案,除Xcode和Unity外更好用更高效的空间应用开发工具和框架,相比iPhone和Vision Pro更优秀的空间视频拍摄设备和易用的创作工具,能匹配Vision Pro分辨率的全景视频录制设备等等等等,这些赛道都将伴随着空间计算的爆发迎来高速的增长。

如果说WWDC 23上,Vision Pro在刚刚发布时给我们的印象是一台100分的产品,那么彼时其他XR硬件厂商的产品,甚至无法达到及格线的标准。而在实际体验后,抛开价格因素我们依然给Vision Pro打出了100分的评分,因为这是你目前能够在市面上买到的、体验最出色的头显产品。但如果考虑到Vision Pro昂贵的售价,此时其他XR硬件厂商的部分顶尖产品,在我们心中已经能够达到80分以上,甚至某些场景下相比Vision Pro已经成为更具性价比的选择。

空间计算时代的序幕已经由Vision Pro掀起,一如苹果的Macintosh开启了PC的GUI时代。Vision Pro或许并非真正的「爆款」,其最重要的意义也并不在于销量,而是驱散了笼罩在XR产业前方的迷雾,告诉了市场达到及格线的空间计算设备应该怎么做,未来的技术研发应当投向哪些地方,同时带动了XR供应链的进化,加速了更多厂商的新一代XR硬件涌现。

除此之外,Vision Pro也再次证明了,无论是XR也好,还是空间计算也罢,依然是一个长线产业,需要的不是一款明星产品扛下所有,而是多个平台、多种生态的产品共同促进市场的繁荣。百花齐放的市场,加上对长期主义的坚持,才是通向下一代计算平台的方舟。